Marlene’s corner poursuit les collaborations en accueillant un nouvel invité : Romain Féret, chargé de mission Open Access et données de la recherche au SCD de l’université de Lille, qui a bien voulu nous raconter son expérience du Barcamp berlinois organisé en marge de l’Open science conference 2019. Merci à lui.

Je suis allé à la conférence Science Ouverte de Berlin mi-mars pour y présenter un poster sur la démarche d’accompagnement de projets ANR et H2020 mise en place au SCD de l’Université de Lille (voir le poster). La conférence était précédée par un barcamp le lundi : petit retour sur ce qui s’y est dit.

Le Barcamp, c’est quoi ?

Pour les non-initiés, un Barcamp c’est un groupe de participants qui se retrouvent pour échanger sur des sujets choisis collectivement, en lien avec une thématique définie au préalable. Ensuite, on secoue et on voit ce qui se passe. Comme le principe de base est la participation, chacun est responsable de l’intérêt de la journée.

Le Barcamp déroulé et ambiance générale

Nous étions un peu plus de 70 participants à se retrouver dans les bureaux de Wikimedia Allemagne. On démarre la journée par une petite présentation brise-glace. Chacun se présente avec 3 hashtags qui lui correspondent et en profite pour donner son nom et son affiliation institutionnelle. Pour terminer la partie introductive, Claudia Göbel, de l’European citizen science association, fait une présentation sur les sciences participatives. Le Barcamp est divisé en 5 temps de 45 minutes, avec 4 sessions en parallèle, soit un total de 20 sessions. Celles et ceux qui le souhaitent proposent des thèmes, qui sont retenus ou non en fonction de l’intérêt des autres participants. La personne qui a proposé le thème anime les échanges. L’ambiance générale est à la fois studieuse et conviviale. Les échanges se font dans un cadre assez sécurisant. La Friendly space policy m’a semblé respectée. Par ailleurs, l’esprit est constructif : personne ne monopolise la parole, bonne écoute, esprit très horizontal même avec des participants qui ont parfois une certaine notoriété. Cela n’empêche pas un peu de controverse, mais c’est de bon aloi et dans l’esprit du jeu.

Petit compte-rendu des ateliers suivis

J’ai suivi 4 sessions au cours de la journée et j’en ai animé une. Voici un résumé de ce que j’ai retenu des sessions suivies. Il y a un compte-rendu pour chacune des sessions mais il est parfois (très) incomplet.

Participatory research challenges (lien pad)

Session animée par Claudia Göbel sur les sciences participatives. L’échange s’engage sur les freins à lever pour que les sciences participatives se développent. Une des difficultés du côté des chercheurs est que la dimension participative doit être pensée dès la conception de la recherche. Comme cela est rarement le cas, cet aspect de la recherche est souvent vu comme du travail supplémentaire en cours de recherche et la dimension participative n’existe, au mieux, qu’au moment de la dissémination des résultats. Certains participants posent aussi la question de l’indépendance des chercheurs vis-à-vis des communautés qu’ils étudient.

Du côté des participants, citoyens ou acteurs de la société civile, la différence de temporalités avec les chercheurs peut freiner leur engagement dans ce type de processus. Pour les chercheurs, la publication des résultats dans des articles de revues est souvent un préalable à d’autres formes de restitution, tandis que les citoyens et acteurs de la société civile ont des besoins de retour plus immédiats. Le manque de réciprocité de certains chercheurs vis-à-vis des participants à leurs recherches est souligné plusieurs fois. Par exemple, les participants ne sont pas toujours informés de la publication des résultats, ou ils n’ont pas accès aux publications.

Brainstorming on open science activities (lien pad)

Session animée par Helen Brinken (@helenebrinken), du projet Foster, pour échanger sur les activités de soutien à la recherche et la manière d’interagir avec les chercheurs. Parmi les idées : faire identifier un problème aux chercheurs puis les aider à le résoudre ; adopter d’abord une posture d’écoute avant de chercher à les convaincre ; engager les chercheurs dans une relation (« engagement process »). Les pratiques à éviter : dire aux chercheurs ce qu’ils doivent faire, faire des listes de listes, culpabiliser les personnes ayant des pratiques que l’on ne juge pas assez ouvertes.

L’échange s’est poursuivi avec un tour de salle sur les motivations qui ont poussé les uns et les autres à travailler ou à s’engager sur les questions de libre accès. Deux catégories de motivation se dégagent. D’un côté, pour les chercheurs présents cela a souvent démarré par des discussions avec des collègues et la prise de conscience du fonctionnement de l’écosystème éditorial et des inégalités de modalités d’accès à l’information scientifique. D’un autre côté, les personnes en charge de la documentation qui sont venues aux questions de science ouverte dans le cadre de leur parcours professionnel, avec des motivations souvent plus pratiques.

Open science as a library service (lien pad)

Session animée par Christina Riesenweber (@c_riesen) qui prendra prochainement la direction d’une bibliothèque dans laquelle elle aura pour mission de développer les services en lien avec les services à la recherche. Les échanges ont porté sur les services avec lesquels interagir dans une université, les compétences à acquérir pour les personnels de bibliothèque et sur différents exemples de bibliothèques « modèles » en matière de services à la recherche (Edimbourg, Utrecht, Helsinki).

Including open science in project management activities (lien pad)

La session que j’ai animée portait sur l’aide que les services de soutien à la recherche peuvent apporter aux chercheurs pour intégrer une dimension science ouverte à leur projet dès la phase de montage. Cela permet de s’assurer que ces activités soient prises en compte dans l’ensemble de la gestion du projet. Les échanges ont été intéressants, avec notamment le retour d’expérience d’Ivo Grigorov (@OAforClimate) qui est responsable du service de montage de projet de son institution et qui est engagé dans une démarche assez similaire à la nôtre dans le cadre d' »Open Science Clinique », porté au sein du projet Foster (voir le poster présenté à la conférence).

Le constat de départ est que la phase de soumission d’un projet de recherche est le meilleur moment pour mettre en place une démarche science ouverte. Il est par exemple préférable d’expliciter les modalités de partage des données entre les partenaires d’un projet dès son montage. Quand ce n’est pas le cas, cela peut être un sujet de conflit. Si la dimension science ouverte d’un projet est positivement évaluée par l’agence de financement, cela peut aussi être une incitation à la mettre en oeuvre en cours de projet. Yan Wang et Esther Plomp, toutes deux data stewards à Delft, ont commencé à travailler sur ce type de services depuis que les agences de financement néerlandaises ont inséré un paragraphe dédié à la gestion des données dans les trames des dossiers de demande de financement.

Researchers engagement in Open Science (lien pad)

Session animée par quatre des data stewards de l’Université technologique de Delft : Heather Andrews, Nicolas Dintzner, Esther Plomp (@PhDToothFAIRy) et Yan Wang (@yan_wang). La session a principalement porté sur la démarche d’accompagnement à la gestion des données mise en place à l’Université de Delft et la manière dont le travail des data stewards s’articule avec les autres services de la bibliothèque.

Les data stewards sont répartis dans chacune des facultés de l’université. La bibliothèque coordonne le dispositif, financé par l’université. Les huit data stewards se réunissent une fois par semaine pour coordonner leur travail. Même si les défis rencontrés selon les disciplines ne sont pas les mêmes, cela leur permet de partager leur expertise sur les questions transversales. Les data stewards ne travaillent que sur les données de recherche, et renvoient vers leurs collègues de la bibliothèque sur les questions relevant des autres aspects de la science ouverte. La prise de conscience des enjeux autour des données de recherche par la communauté scientifique de l’Université de Delft entraîne un accroissement de la charge de travail des data stewards, qui ne sont pas assez nombreux pour accompagner l’ensemble des chercheurs. L’importance de travailler de manière coordonnée avec les autres services de l’université a aussi été soulignée.

De l’intérêt de suivre le Barcamp avant d’assister à la conférence

Au-delà de son intérêt intrinsèque, participer au Barcamp a été une bonne manière de préparer la conférence. C’est un moment privilégié pour identifier des interlocuteurs et échanger avec des personnes que l’on croisera au cours des deux jours suivants. C’est aussi l’opportunité de se mettre en position plus active, en particulier lorsqu’on va à un évènement où on connait très peu de collègues. Le Beercamp qui a suivi était aussi une bonne occasion de poursuivre les échanges.

Les plus du Barcamp

La prise de note collaborative, avec un référencement des pads des différentes sessions qui sont accessibles à partir du métapad. Les échanges ont été plus ou moins bien retranscrits mais c’est un bon outil pour garder une trace d’une session tout en s’impliquant pleinement dans les échanges. Par ailleurs, les collègues de Delft ont mis en ligne un article de blog qui rend compte de la quasi totalité des sessions proposées.

L’Open Science radio (@OpenSciRadio) : Konrad Förstner (@konradfoerstner) et Bernd Rupp ont interviewé l’ensemble des animateurs de session au fur et à mesure de l’avancement de la journée. Les podcasts ont été mis en ligne presque immédiatement et sont disponibles sur leur site web. Ils ont récidivé pendant la conférence les deux jours suivants, avec l’aide de Matthias Fromm (@matthiasfromm) et Christina Riesenweber au montage. Un format intéressant pour communiquer sur l’évènement et pour donner envie d’aller creuser le contenu des sessions à partir d’un média plus attrayant que les prises de note rédigées.

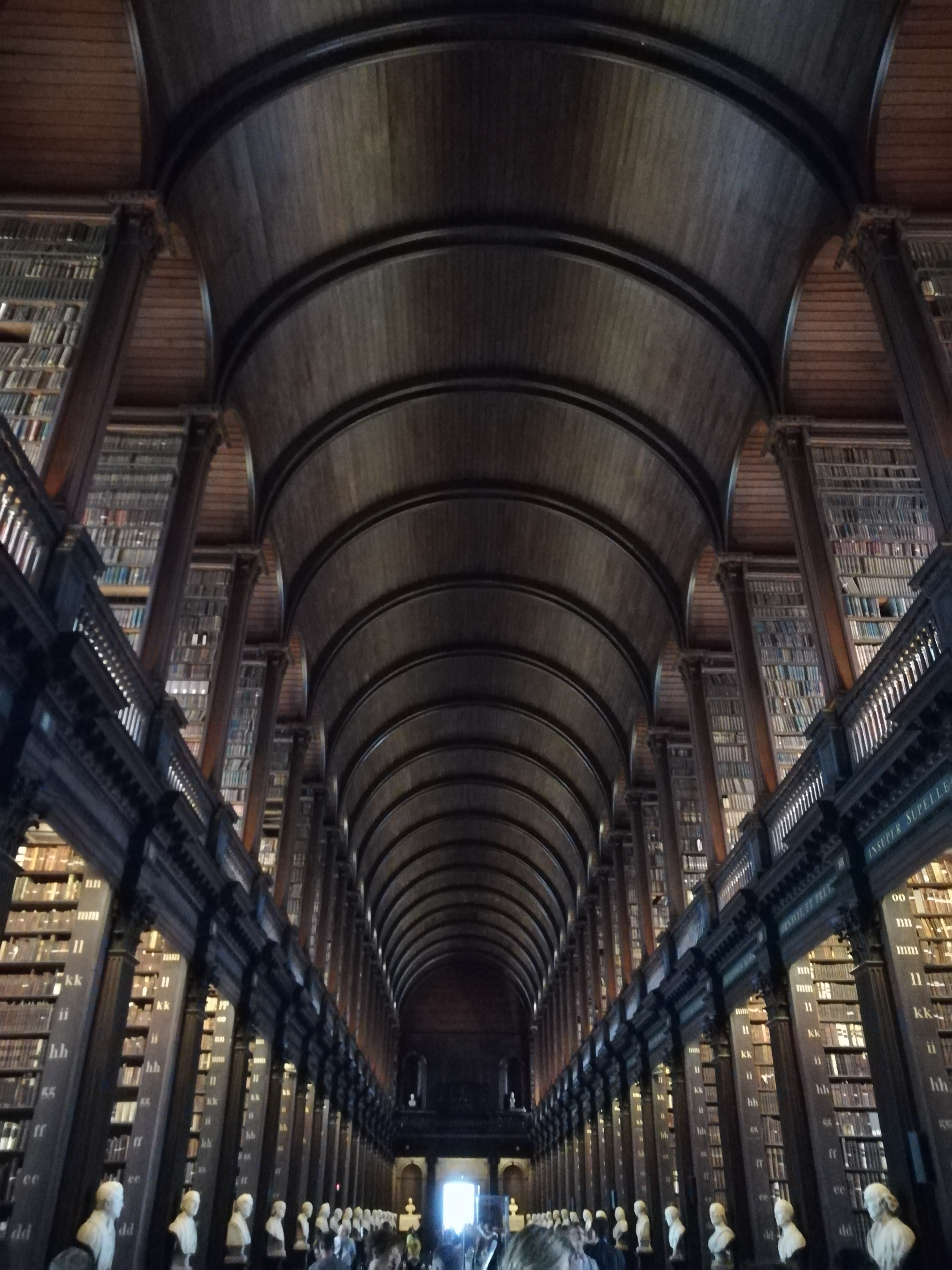

J’ai eu la chance d’assister à la conférence LIBER, qui avait lieu cette année au Trinity College, à Dublin. La thématique de cette année, «

J’ai eu la chance d’assister à la conférence LIBER, qui avait lieu cette année au Trinity College, à Dublin. La thématique de cette année, «